人工智能 因果学习篇(1)-后门准则

后门准则 本次分享的知识来源于《Causal Inference in Statistics:A Primer》的翻译版本《统计因果推理入门》,该书由杨娇云等人翻译,主要包括因果学习的基础知识。 电子图书获取方法: 关注公众号“AI八倍镜”并回复“因果学习”。 知识回顾 在上一小节“校正公式”当中,学习到

后门准则 本次分享的知识来源于《Causal Inference in Statistics:A Primer》的翻译版本《统计因果推理入门》,该书由杨娇云等人翻译,主要包括因果学习的基础知识。 电子图书获取方法: 关注公众号“AI八倍镜”并回复“因果学习”。 知识回顾 在上一小节“校正公式”当中,学习到

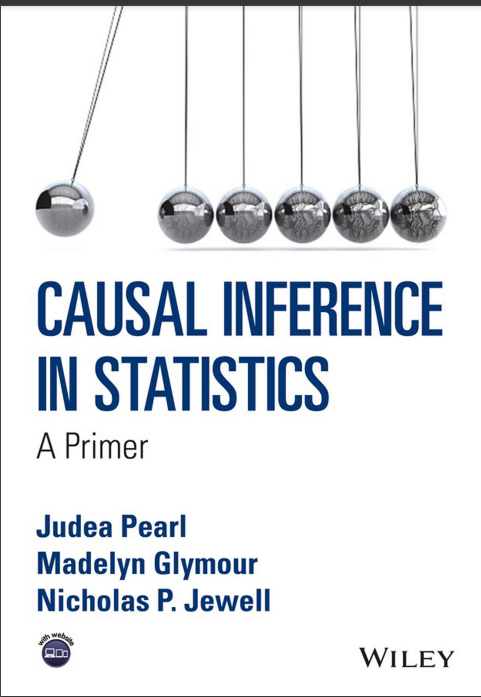

开篇一张图: 变量和图片解释: 三个正方体:特征向量,比如说图像的特征,H表示图片高度、W表示图片宽、C表示通道(黑白1通道、彩色3通道) 字母: X表示输入特征; Ftr表示的是对X进行一次卷积,也就是对特征进行一系列的操作之后的结果,表示为U; Fsq(.)表示的是对U进行压缩; Fex(.)表示的是对U进行激活(

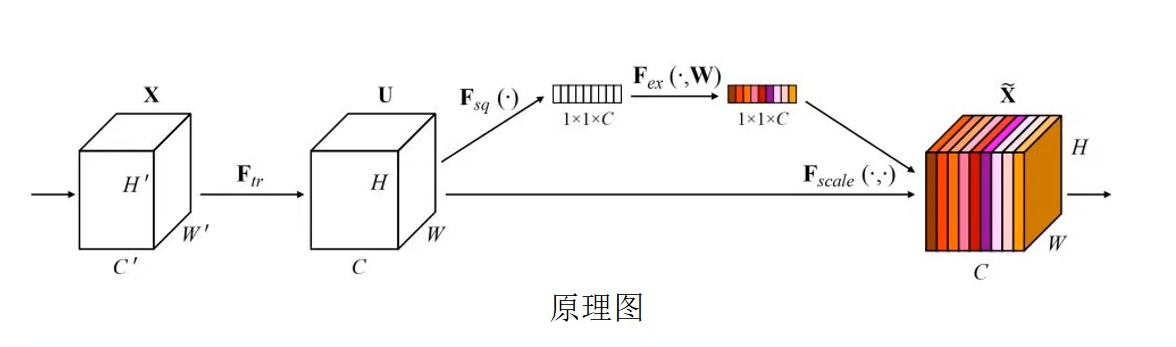

Transformer 从整体框架来讲,Transformer其实就是encode-decode框架,即就是编码解码。只不过在编码和解码的内部比较复杂,经过了多次复杂计算。 比如说,encode编码阶段,其内部整体框架如图所示。 在图上可以看出,首先输入所有的向量,然后经过多次block的计算,最终得到相同数量的输

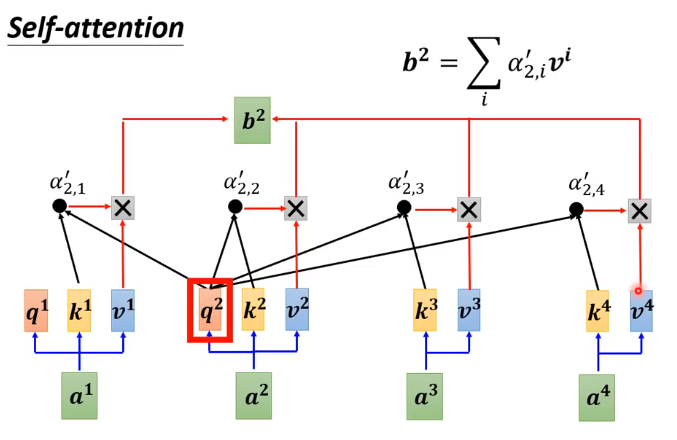

自注意力机制(Self-attention) 背景 最近,学了好多东西,今天看了一下李飞飞老师讲解的自注意力机制,因此在这记录一下,以供日后复习,同时自己学习消化知识也好。 综述 一般来说,模型的输入输出有三种: N个输入,经过模型计算后,输出N个结果,也就是对输入向量进行计算,从而得到每个向量对应的输出值。 N个输入

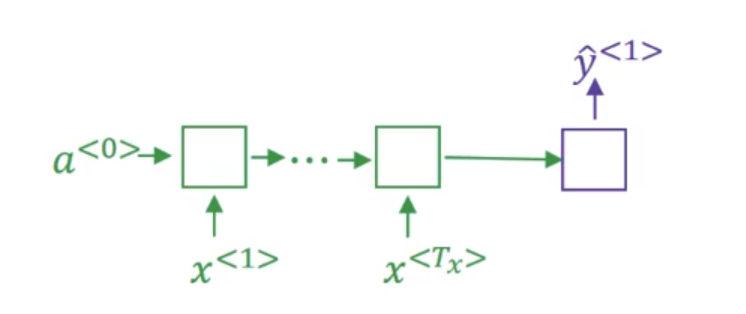

集束搜索(Bean Search) 背景 场景一:如果说,你想实现:输入一段语音片段,经过一一列操作,实现最后输出语音的内容。再此过程中,假如你不想随机输出一些结果,而想得到最好最优的输出结果,此时,则需要本算法。 场景二:实现机器翻译,输入一段法语,输出一段最有的翻译结果。 方法: 1. 使用的

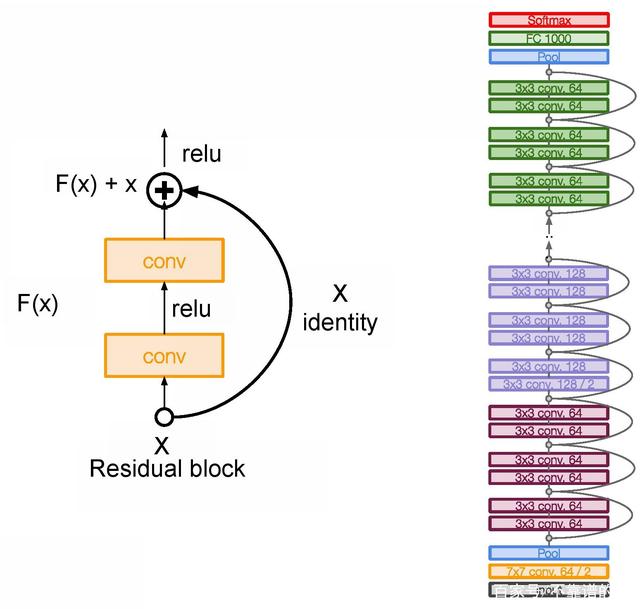

Resnet Resnet即就是残差网络,本文主要是对于resnet给出的网络结构图进行简单解释。 网络结构图 以上就是34层网络的网络结构图。 以上是18层、34层、50层、101层以及152层网络所对应的残差块。 我刚开始在网上看到这两张图片的时候,感觉一点都不懂,后面学了一下,稍微懂了,所以写下这篇博文做个记录。

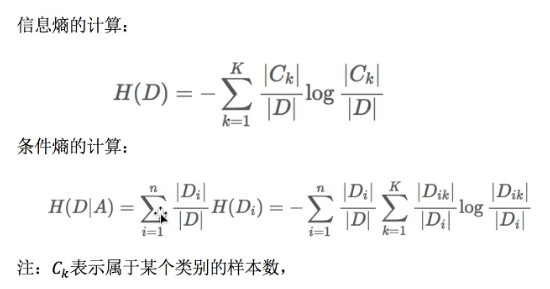

开发流程 原始数据 --> 数据特征工程(训练数据和测试数据) --> 选择合适的算法进行学习 --> 建立模型 --> 模型评估(测试数据) --> 判断模型是否合格 --> 模型应用(一般以API的形式提供) 算法分类 数据类型 离散型:由记录不同类别个题的数目所得到的数据,又称

概述 机器学习是从数据中自动分析获得规律(模型),并利用规律对未知数据进行预测。 数据集的构成 存储类型:文件格式(如csv) 可用的数 scikit-learn Kaggle UCI 常用数据集数据的结构组成 结构:特征值 + 目标值 处理: pandas:一个数据读取非常方便以及基本的处理格式的工具 sklearn

最新评论

张苹果博客

评:友情链接你好博主,麻烦把“VAE+”这个友链删除,已经不用了。更换最新友链地址: 名称:张苹果 网址:https://zhangpingguo.com 图标:https://zhangpingguo.com/logo.jpg 描述:这个人很简单,没什么好说的。

bobo live casino

评:留言我觉得你提到的这个问题很有意思,也很实用。根据我的经验,可能有几个方向可以尝试: 确认一下基础设置:有时候问题可能出在一些小的配置或设置上,可以重新检查一下相关的设置,看看有没有什么遗漏。 参考一些常见问题解答(FAQ)或指南:有时候论坛里其他人可能遇到过类似的问题,查看一下FAQ或者其他人的建议可能能帮助你找到解决方法。 试试其他方法:如果当前的方法行不通,可以考虑其他的替代方案,或者逐步排除不同的可能性来找出问题的根源。

jiyouzhan

评:因果学习篇(2)-Causal Attention for Vision-Language Tasks(文献阅读)这篇文章写得深入浅出,让我这个小白也看懂了!

ccbbp

评:wordpress自动生成站点地图sitemap.xml教程博客很难了,新的百度不收了

楠怪

评:wordpress自动生成站点地图sitemap.xml教程还搞博客呢

clash节点

评:友情链接友链申请 网站名称:clash节点 网站链接:https://clashgithub.com/ 网站头像:https://clashgithub.com/wp-content/themes/modown/static/img/logo.png 网站描述:免费公益SSR/V2ray/Shadowrocket/Clash节点/小火箭订阅链接|科学上网|免费梯子

机灵鬼

评:视频行为识别(一)——综述机灵鬼

评:视频行为识别(二)——小样本动作识别的分层组合表示开心鬼

评:因果学习篇(1)-后门准则写的不错。

BG7ZAG

评:留言你的回复邮件发了两条,估计的插件冲突了,一条是主题自带的评论回复,一条比较简单的文本回复 [图片]